Hugging Face: ¿El ‘Santo Grial’ de la IA o un Nido de Serpientes para Ingenieros Novatos?

Hugging Face se ha posicionado como la plataforma líder para el machine learning de código abierto. Pero, ¿es realmente la solución mágica que promete ser, o hay trampas ocultas en su ecosistema? En este análisis a fondo de 2026, destriparemos Hugging Face para revelar sus verdaderos puntos fuertes, sus debilidades más flagrantes y si realmente vale la pena invertir tu tiempo (y dinero) en esta plataforma. Prepárate, porque vamos a sumergirnos en la realidad, sin edulcorantes ni falsas promesas.

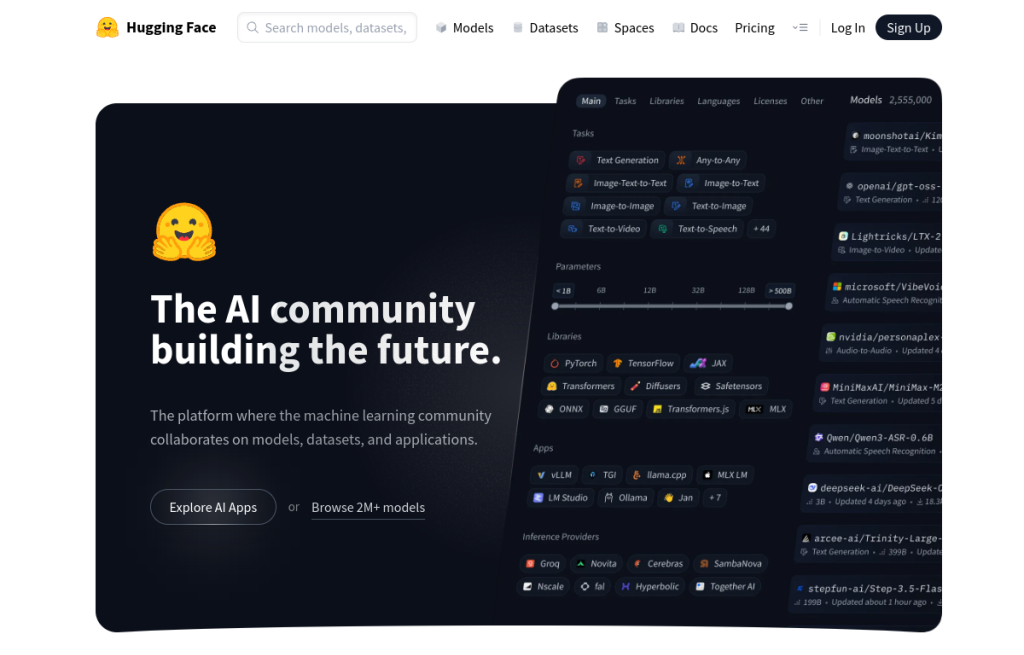

Hugging Face es mucho más que una simple biblioteca de Transformers. Es un ecosistema completo que abarca modelos pre-entrenados, datasets, herramientas de entrenamiento y despliegue, y una comunidad activa de investigadores y desarrolladores. En teoría, promete democratizar el acceso al machine learning. Pero, ¿lo consigue realmente? Vamos a analizarlo desde la perspectiva de un ingeniero de software que ha luchado en las trincheras del ML en producción.

Uno de los mayores atractivos de Hugging Face es su Model Hub, que alberga miles de modelos pre-entrenados para diversas tareas. Esto te permite ahorrar tiempo y recursos al no tener que entrenar modelos desde cero. Puedes encontrar modelos para clasificación de texto, generación de texto, traducción automática, reconocimiento de voz, y mucho más. Pero, ¡cuidado!, no todos los modelos son iguales. La calidad y el rendimiento pueden variar significativamente.

- Pros: Amplia variedad de modelos pre-entrenados, facilidad de uso, comunidad activa.

- Contras: Documentación confusa, calidad variable de los modelos, curva de aprendizaje para usuarios novatos.

Sin embargo, no todo es color de rosa. La curva de aprendizaje para usuarios novatos puede ser empinada. Entender los conceptos fundamentales del machine learning y la arquitectura de los Transformers es esencial para aprovechar al máximo la plataforma. Si eres nuevo en el mundo del ML, prepárate para invertir tiempo en aprender los fundamentos.

Además, la gestión de dependencias y la configuración del entorno pueden ser un desafío, especialmente al trabajar con modelos complejos. Asegúrate de tener un buen manejo de Python, pip, y herramientas de gestión de entornos como conda o virtualenv. La reproducibilidad es clave en el machine learning, y Hugging Face puede ayudarte a lograrla, pero requiere disciplina y atención al detalle.

Pero espera, hay más. Hugging Face también ofrece herramientas para el entrenamiento y despliegue de modelos. Puedes utilizar su plataforma Accelerate para entrenar modelos a gran escala en múltiples GPUs o TPUs. Y puedes desplegar tus modelos en la nube utilizando su Inference API. Estas herramientas pueden simplificar enormemente el ciclo de vida del machine learning, pero también añaden complejidad adicional.

En resumen, Hugging Face es una plataforma poderosa y versátil que puede acelerar significativamente el desarrollo de aplicaciones de machine learning. Pero no es una solución mágica. Requiere conocimiento, esfuerzo y dedicación para aprovechar al máximo su potencial. Si estás dispuesto a invertir el tiempo y la energía necesarios, Hugging Face puede ser una herramienta invaluable en tu arsenal de ingeniero de software.

Piénsalo de este modo: Hugging Face es como un coche de carreras. Puede llevarte muy rápido, pero necesitas saber conducir para no estrellarte. Así que, ponte el cinturón, ajusta el asiento, y prepárate para la aventura.

Plan Gratuito

- Acceso a la mayoría de los modelos pre-entrenados

- Uso limitado de la Inference API

- Soporte de la comunidad

Plan Pro

- Mayor uso de la Inference API

- Soporte prioritario

- Herramientas de entrenamiento avanzadas

Plan Enterprise

- Uso ilimitado de la Inference API

- Soporte dedicado

- Acuerdos de nivel de servicio (SLAs)

¿Qué tipos de modelos ofrece Hugging Face y cómo puedo utilizarlos en mis proyectos?

Hugging Face ofrece una amplia variedad de modelos pre-entrenados, que abarcan desde procesamiento del lenguaje natural (NLP) hasta visión artificial y audio. Estos modelos están disponibles en el Model Hub, donde puedes filtrarlos por tarea, lenguaje, framework (PyTorch, TensorFlow, etc.) y licencia. Para utilizarlos, puedes emplear la librería `transformers` de Hugging Face, que proporciona una interfaz sencilla para descargar y cargar los modelos, así como para realizar inferencia. Es crucial entender la licencia del modelo antes de usarlo en proyectos comerciales.

¿Cómo puedo contribuir a la comunidad de Hugging Face y compartir mis propios modelos?

Puedes contribuir a la comunidad de Hugging Face de varias maneras. La más común es compartiendo tus propios modelos en el Model Hub. Para ello, debes crear una cuenta en Hugging Face y subir tu modelo utilizando la herramienta `transformers` o la API de Hugging Face. Asegúrate de documentar adecuadamente tu modelo, incluyendo una descripción, instrucciones de uso y ejemplos. También puedes contribuir mejorando la documentación, corrigiendo errores en el código o participando en la comunidad a través de foros y discusiones.

¿Cuáles son las consideraciones de seguridad al utilizar modelos de machine learning de terceros en Hugging Face?

Al utilizar modelos de terceros en Hugging Face, es fundamental considerar la seguridad. Realiza pruebas exhaustivas para detectar posibles sesgos o vulnerabilidades. Examina el código del modelo (si está disponible) en busca de código malicioso. Utiliza herramientas de seguridad para analizar el modelo y sus dependencias. Considera el origen del modelo y la reputación del autor. Implementa medidas de seguridad adicionales, como el aislamiento del modelo y la validación de las entradas.

¿Cómo puedo optimizar el rendimiento de los modelos de Hugging Face para implementaciones en producción?

Optimizar el rendimiento de los modelos de Hugging Face para producción requiere un enfoque multifacético. Utiliza técnicas de cuantización para reducir el tamaño del modelo y acelerar la inferencia. Emplea la librería `torch.compile` (si usas PyTorch) para optimizar el grafo de computación. Considera la destilación del conocimiento para transferir el conocimiento de un modelo grande a uno más pequeño. Utiliza hardware especializado, como GPUs o TPUs, para acelerar la inferencia. Implementa un sistema de caching para evitar recalcular predicciones repetidas. Monitorea el rendimiento del modelo en producción y ajusta los parámetros según sea necesario.

¿Qué estrategias puedo implementar para mitigar el sesgo en los modelos de Hugging Face?

Mitigar el sesgo en los modelos de Hugging Face es crucial para garantizar resultados justos y equitativos. Inspecciona los datos de entrenamiento en busca de posibles sesgos. Utiliza técnicas de aumento de datos para equilibrar las representaciones de diferentes grupos. Aplica técnicas de regularización para penalizar la dependencia de características sesgadas. Evalúa el rendimiento del modelo en diferentes subgrupos de la población y ajusta el modelo para mejorar la equidad. Considera el uso de modelos específicamente diseñados para mitigar el sesgo.

¿Cuáles son las mejores prácticas para el versionado y la gestión de modelos en Hugging Face?

El versionado y la gestión de modelos son esenciales para garantizar la reproducibilidad y la trazabilidad. Utiliza un sistema de control de versiones (como Git) para rastrear los cambios en el código del modelo y los datos de entrenamiento. Almacena los modelos en un repositorio centralizado (como el Model Hub de Hugging Face). Utiliza etiquetas y metadatos para describir cada versión del modelo. Implementa un sistema de gestión de modelos que te permita rastrear el linaje del modelo, desde los datos de entrenamiento hasta la implementación en producción. Documenta el proceso de entrenamiento del modelo, incluyendo los parámetros, las métricas y los resultados.

¿Cómo puedo utilizar Hugging Face para tareas de generación de texto condicional, como la traducción automática o la generación de resúmenes?

Hugging Face ofrece potentes herramientas para la generación de texto condicional. Utiliza modelos como T5 o BART para tareas de traducción automática, generación de resúmenes o generación de diálogos. Aprovecha la clase `pipeline` de la librería `transformers` para simplificar el proceso de inferencia. Experimenta con diferentes estrategias de decodificación, como beam search o sampling, para controlar la calidad y la diversidad del texto generado. Entrena tus propios modelos en datos específicos para obtener resultados más personalizados.

¿Qué herramientas y técnicas puedo utilizar para depurar y diagnosticar problemas en los modelos de Hugging Face?

Depurar y diagnosticar problemas en los modelos de Hugging Face requiere un enfoque sistemático. Utiliza herramientas de visualización para inspeccionar los datos de entrenamiento y las activaciones del modelo. Implementa pruebas unitarias para verificar la corrección del código del modelo. Utiliza herramientas de profiling para identificar cuellos de botella en el rendimiento. Examina los registros del modelo en busca de errores o advertencias. Utiliza técnicas de depuración simbólica para comprender el comportamiento del modelo. Analiza los gradientes del modelo para identificar posibles problemas de entrenamiento.

Encuentra el software ideal para tu empresa

Analizamos tu caso y te recomendamos la mejor solución tecnológica según tus procesos, objetivos y presupuesto.

Asesoría 100% gratuita · Sin compromiso